AI 기반 감지기는 AI가 생성 한 가짜 비디오를 탐지하는 데 가장 적합한 도구입니다. 게티 이미지를 통한 워싱턴 포스트

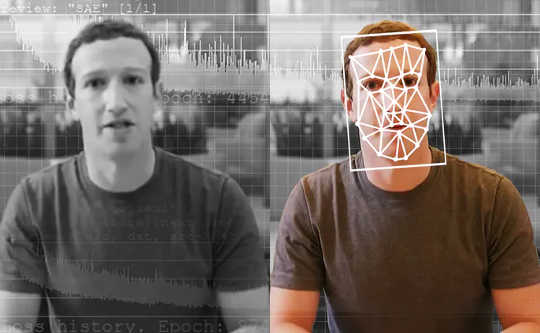

조사 기자가 익명의 내부 고발자로부터 비디오를받습니다. 불법 행위를 인정한 대통령 후보를 보여준다. 하지만이 비디오가 진짜인가요? 그렇다면 그것은 일생의 특종 인 거대한 뉴스가 될 것이며 다가오는 선거를 완전히 뒤집을 수있을 것입니다. 그러나 기자는 전문 도구를 통해 비디오를 실행하는데, 이는 비디오가 보이는 것과 다르다는 것을 그녀에게 알려줍니다. 사실, 그것은 "딥 페이크,”인공 지능을 사용하여 만든 비디오 깊은 학습.

전 세계의 언론인들은 곧 이와 같은 도구를 사용할 수 있습니다. 몇 년 후에는 모든 사람이 소셜 미디어 피드에서 가짜 콘텐츠를 근절하기 위해 이와 같은 도구를 사용할 수도 있습니다.

As 연구원 딥 페이크 탐지를 연구해온 언론인을위한 도구를 개발하면 이러한 도구의 미래가 보입니다. 그러나 그들은 우리의 모든 문제를 해결하지 못할 것이며, 허위 정보와의 광범위한 싸움에서 무기고의 일부일뿐입니다.

딥 페이크의 문제

대부분의 사람들은 당신이 보는 모든 것을 믿을 수 없다는 것을 알고 있습니다. 지난 수십 년 동안 정통한 뉴스 소비자들은 사진 편집 소프트웨어로 조작 된 이미지를 보는 데 익숙해졌습니다. 하지만 비디오는 또 다른 이야기입니다. 할리우드 감독은 실제 장면을 만들기 위해 특수 효과에 수백만 달러를 지출 할 수 있습니다. 그러나 딥 페이크를 사용하면 수천 달러의 컴퓨터 장비를 보유한 아마추어와 몇 주를 소비하면 거의 삶에 충실 할 수 있습니다.

Deepfakes를 사용하면 사람들이 결코 없었던 영화 장면에 사람들을 넣을 수 있습니다. 톰 크루즈가 아이언 맨을 연기한다고 생각해 – 재미있는 동영상을 만듭니다. 불행히도 그것은 또한 만들 수 있습니다 동의없는 음란물 묘사 된 사람들의. 지금까지 거의 모든 여성이 딥 페이크 기술이 오용 될 때 가장 큰 희생자입니다.

Deepfakes는 정치 지도자가 한 번도 말하지 않은 내용을 말하는 동영상을 만드는데도 사용할 수 있습니다. 벨기에 사회당은 딥 페이크가 아닌 저품질의 가짜 동영상을 공개했습니다. 벨기에를 모욕하는 트럼프 대통령, 고품질 딥 페이크의 잠재적 인 위험을 보여주기에 충분한 반응을 얻었습니다.

{vembed Y=poSd2CyDpyA}

University of California, Berkeley의 Hany Farid가 딥 페이크를 만드는 방법을 설명합니다.

혹시 가장 무서운, 그들은 만드는 데 사용할 수 있습니다 실제 동영상의 내용에 대한 의심, 딥 페이크 일 수 있음을 제안합니다.

이러한 위험을 감안할 때 딥 페이크를 감지하고 명확하게 레이블을 지정할 수있는 것은 매우 중요합니다. 이렇게하면 가짜 동영상이 대중을 속이지 않고 실제 동영상이 진품으로 수신 될 수 있습니다.

가짜 발견

연구 분야로서의 Deepfake 탐지가 조금 더 시작되었습니다. 3 년 전. 초기 작업은 다음과 같은 비디오에서 눈에 보이는 문제를 감지하는 데 중점을 둡니다. 깜박이지 않은 딥 페이크. 그러나 시간이 지남에 따라 가짜가 좋아졌다 실제 비디오를 모방하고 사람과 탐지 도구 모두를 찾기가 더 어려워집니다.

딥 페이크 탐지 연구에는 두 가지 주요 범주가 있습니다. 첫 번째는 사람들의 행동을보고 비디오에서. 오바마 대통령과 같은 유명한 사람의 비디오가 많다고 가정 해보십시오. 인공 지능은이 비디오를 사용하여 그의 손 제스처부터 말의 일시 중지에 이르기까지 패턴을 학습 할 수 있습니다. 그런 다음 그의 딥 페이크를 봐 해당 패턴과 일치하지 않는 부분을 확인합니다. 이 접근 방식은 비디오 품질 자체가 본질적으로 완벽하더라도 작동 할 수 있다는 장점이 있습니다.

{vembed Y=gsv1OsCEad0}

SRI International의 Aaron Lawson은 딥 페이크를 탐지하는 한 가지 접근 방식을 설명합니다.

다른 연구자들, 우리 팀을 포함하여에 초점을 맞추 었습니다. 차이 그 모든 딥 페이크는 실제 동영상에 비해. Deepfake 비디오는 종종 개별적으로 생성 된 프레임을 병합하여 비디오를 형성하여 생성됩니다. 이를 고려하여 우리 팀의 방법은 비디오의 개별 프레임에있는 얼굴에서 필수 데이터를 추출한 다음 동시 프레임 세트를 통해 추적합니다. 이를 통해 한 프레임에서 다른 프레임으로의 정보 흐름에서 불일치를 감지 할 수 있습니다. 가짜 오디오 감지 시스템에도 비슷한 접근 방식을 사용합니다.

이러한 미묘한 세부 사항은 사람들이보기 어렵지만 딥 페이크가 얼마나 정확하지 않은지 보여줍니다. 아직 완벽 해. 이와 같은 탐지기는 소수의 세계 지도자뿐만 아니라 모든 사람에게 적합합니다. 결국 두 가지 유형의 딥 페이크 탐지기가 필요할 수 있습니다.

최근 탐지 시스템은 도구를 평가하기 위해 특별히 수집 한 비디오에서 매우 잘 작동합니다. 불행히도 최고의 모델조차도 온라인에서 찾은 동영상이 좋지 않음. 이러한 도구를보다 강력하고 유용하게 개선하는 것이 다음 단계의 핵심입니다.

누가 딥 페이크 탐지기를 사용해야합니까?

이상적으로는 모든 사람이 딥 페이크 검증 도구를 사용할 수 있어야합니다. 그러나이 기술은 개발 초기 단계에 있습니다. 연구원은 도구를 광범위하게 공개하기 전에 도구를 개선하고 해커로부터 보호해야합니다.

그러나 동시에 대중을 속이려는 모든 사람이 딥 페이크를 만드는 도구를 사용할 수 있습니다. 옆에 앉는 것은 선택 사항이 아닙니다. 우리 팀에게 올바른 균형은 언론인과 협력하는 것이 었습니다. 언론인은 잘못된 정보의 확산에 대한 첫 번째 방어선이기 때문입니다.

기사를 게시하기 전에 언론인은 정보를 확인해야합니다. 그들은 이미 출처를 확인하고 핵심 사실을 확인하기 위해 한 명 이상을 확보하는 것과 같은 검증 된 방법을 가지고 있습니다. 따라서 도구를 그들의 손에 맡김으로써 우리는 그들에게 더 많은 정보를 제공하고 그들이 실수를 할 수 있다는 점을 감안할 때 기술에만 의존하지 않을 것임을 압니다.

탐지기가 군비 경쟁에서 이길 수 있습니까?

팀을 보는 것은 고무적입니다. 페이스북 과 Microsoft 딥 페이크를 이해하고 감지하기 위해 기술에 투자합니다. 이 분야는 딥 페이크 기술의 발전 속도를 따라 잡기 위해 더 많은 연구가 필요합니다.

언론인과 소셜 미디어 플랫폼은 또한 사람들이 딥 페이크가 감지 될 때 경고하는 가장 좋은 방법을 찾아야합니다. 연구에 따르면 사람들은 거짓말을 기억한다그러나 그것이 거짓말이라는 사실은 아닙니다. 가짜 동영상도 마찬가지인가요? 제목에 "Deepfake"를 넣는 것만으로는 어떤 종류의 잘못된 정보에 대응할 수 없습니다.

Deepfakes가 여기에 있습니다. 인공 지능이 더욱 강력 해짐에 따라 허위 정보를 관리하고 대중을 보호하는 것이 그 어느 때보 다 어려워 질 것입니다. 우리는 탐지가 첫 단계에 불과한이 위협에 대처하는 성장하는 연구 커뮤니티의 일원입니다.![]()

저자에 관하여

컴퓨팅 및 정보 과학 박사 과정 학생 John Sohrawardi, Rochester Institute of Technology 컴퓨팅 보안 교수 인 Matthew Wright는 Rochester Institute of Technology

이 기사는에서 다시 게시됩니다. 대화 크리에이티브 커먼즈 라이센스하에 읽기 실물 기사.